界面新闻记者 | 李京亚

日前,特斯拉CEO埃隆·马斯克率数百位科技行业高管在一封公开信中呼吁,所有人工智能实验室应立即暂停比GPT-4更强大的人工智能系统训练,暂定时间是6个月以上。

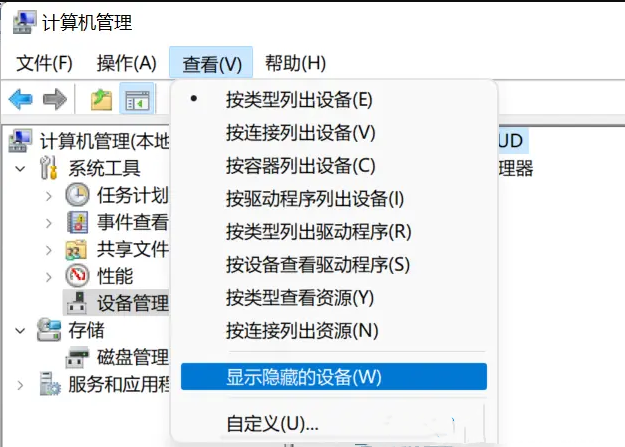

【资料图】

【资料图】

这封题为《暂停巨型人工智能实验》的公开信于3月22日刊登在非盈利组织生命未来研究所(Future of Life Institute)的官网上,其行文明快、语言犀利,详细阐述了具有与人类竞争性的人工智能系统会给社会和文明造成的潜在风险。

图源:生命未来研究所(Future of Life Institute)

“高级人工智能可以代表地球生命史上的深刻变化,应该投入相应的关注和资源进行规划和管理。但不幸的是,这种级别的规划和管理并未发生。在最近几个月,人工智能实验室被锁在一场失控的竞赛之中,大家争相开发和部署更强大的人工智能系统,以至于没有人能够完全理解、预测或可靠地控制这些进程,即使他们的创造者也不能。”

在对可能失去文明控制的风险作出预警后,公开信指出,“只有在我们确信强大的人工智能系统的效果将是积极的,风险是可控的,才应该开发。”

公开信的作者们呼吁,希望暂停至少6个月高级人工智能开发,直到各界共同制定出一套能顺利实施并由独立专家审计的安全协议。

“因此,针对任何比GPT-4更强大的人工智能系统的训练,我们呼吁所有人工智能实验室立即暂停至少6个月。这种暂停应该是公开的和可核查的,并囊括所有关键参与者。如果这种暂停不能迅速颁布,各国政府应该介入并制定暂停令。”

公开信还提到,6个月的暂停并不意味着人工智能总体发展的暂停,只是从目前危险的竞赛中退后一步。

在公开信的末尾,作者们将目前人工智能发展现状比作收获回报的盛夏,并再次强调对人工智能发展过快进行控制是为了让大家享受一个更漫长的盛夏,而非在毫无准备的情况下匆忙入秋。

截至发稿,这封公开信获得了1126个签名支持,埃隆·马斯克于公开信下第三位签名,苹果联合创始人史蒂夫·沃兹尼亚克紧随其后,署名序列中还包括Stability AI的创始人穆斯塔克、Skype的联合创始人和Pinterest联合创始人,以及一位图灵奖得主。

署名人员中目前没有OpenAI员工的身影。据媒体报道,OpenAI的首席执行官阿尔特曼的名字曾短暂出现在署名名单中,此后消失。但有四名谷歌员工在名单上署名,包括来自谷歌旗下人工智能实验室DeepMind的三名研究科学家。

图源:生命未来研究所(Future of Life Institute)

在马斯克与OpenAI创始人阿尔特曼的矛盾近日见诸报端之后,马斯克发表这封公开信并不令人意外。

公开信的刊发组织——生命未来研究所(Future of Life Institute)是一个成立于2014年的非盈利机构,由麻省理工物理系终身教授迈克斯·泰格马克和其他四位成员共同创立,组织的研究宗旨是探索人工智能的发展对人类的益处,并降低核武器以及生物技术对人类带来的风险。在其科学顾问委员会成员中,马斯克赫然在列。

众所周知,在特斯拉和SpaceX的事务之外,马斯克一直对输出人工智能观点极为上心。几乎每年,他都会率众发表重量级公开信对人工智能技术前景表达忧虑。苹果联合创始人史蒂夫·沃兹尼亚克和DeepMind的一些重量级科学家是他在此事上的多年搭档。

有观点指出,在OpenAI创立中扮演了重要角色的马斯克,由于2018年选择离场,导致其现在与大语言模型和OpenAI这两个科技界最重要的风口毫无关系,这让他面对GPT-4的成功时加倍痛苦。

而这次的公开信正是在OpenAI发布多模态预训练大模型GPT-4仅两周后发出的。GPT-4被誉为有史以来最强大的人工智能系统。随着人工智能领域研究人员们因GPT4的到来对通用人工智能AGI的预期变得乐观,一些谨慎的创业者、投资人、专家和监管机构开始悲观审视人工智能引发的军备竞赛带来的风险。

本周一,欧盟执法机构欧洲刑警组织(Europol)在一份技术报告中发出警告:聊天机器人ChatGPT可能被滥用于网络钓鱼、宣传虚假信息以及网络犯罪。路透社将这份技术报告与马斯克等人的公开信归为给生成式AI大好前景泼冷水的“大合唱”开端。

(文章来源:界面新闻)